ChatGPTやDeepSeekって、中身はどうなってるの?と気になったことはありませんか?AIは使えても、その内部構造はブラックボックスのまま、という人がほとんどだと思います。

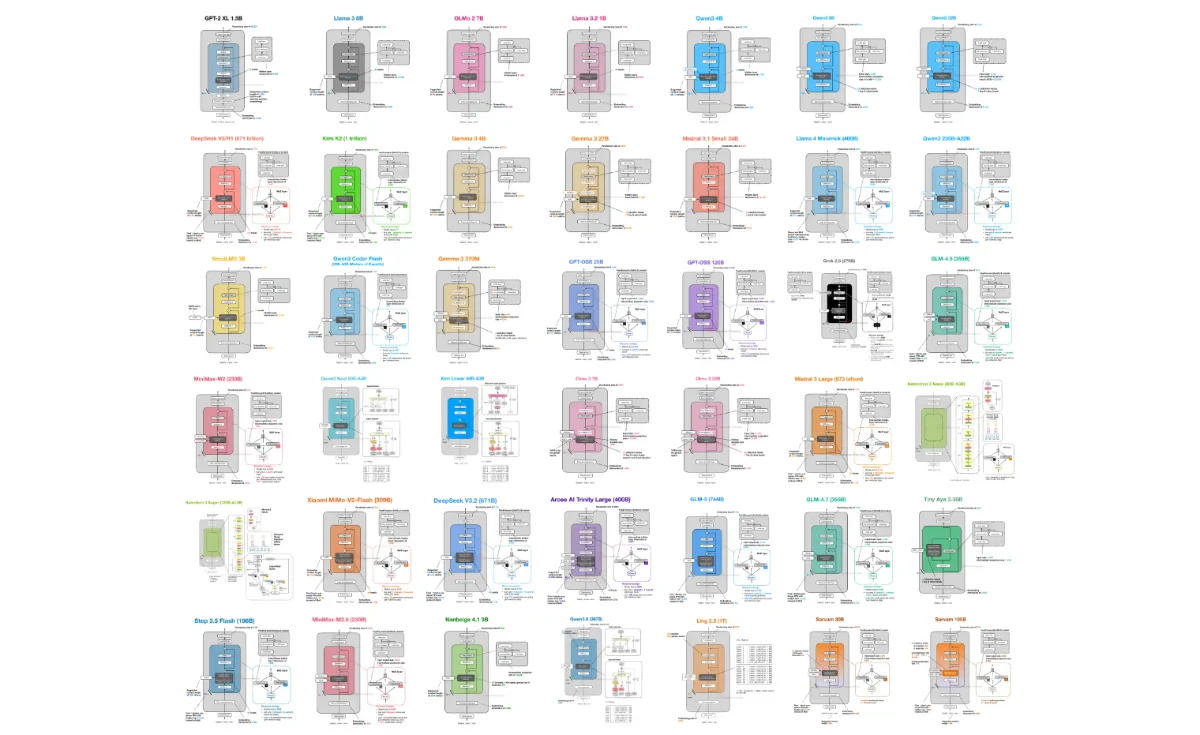

そんな疑問に答えてくれる、とても便利なページが登場しました。機械学習の研究者であるSebastian Raschka博士が公開したLLM Architecture Gallery(LLMアーキテクチャギャラリー)です。2026年3月時点で39種類以上もの最新AI(大規模言語モデル)の内部設計図が、一か所にずらりと並んでいます。

このページのどこに注目すれば面白いのか、専門知識ゼロでも理解できるよう、わかりやすく解説していきます。

LLMアーキテクチャギャラリーって何?

最新のAIモデルの設計図を横並びで比較できる図鑑サイトです。GPT-2(2019年)から始まり、DeepSeek、Llama 4、Qwen3、Kimi K2など、2024〜2026年の最先端モデルまでがずらりと収録されています。

ただの図鑑ではありません。各モデルのカードには、パラメータ数、公開日、設計の種類、注意機構の方式、論文へのリンク、実装コードへのリンクまで付いています。研究者がバラバラに公開していた情報を、一か所で素早く見比べられるようにまとめた、いわばAIの世界地図です。

Sebastian Raschka博士とは:

機械学習の研究者・教育者として知られ、Build a Large Language Model From Scratchなどの著書で有名な人物です。LLMの内部構造をわかりやすく解説することで定評があり、今回のギャラリーも彼の連載記事The Big LLM Architecture Comparisonをまとめたものです。

なぜ設計図を比べることが重要なのか

AIモデルの性能はよくパラメータ数が多いほど賢いと言われます。しかし最近の競争は、それだけでは語れなくなっています。

このギャラリーを見ると、最新の競争はいかに巨大化するかではなく、いかに賢く・速く・安く動かすかに移っていることがはっきりわかります。

たとえば、中国発のDeepSeek V3というモデルは、総パラメータ数が671億個(6710億ではなく、正確には6710億のパラメータを持つ6710億パラメータモデル)あります。しかし1回の会話で実際に動くのはそのうちの37億個だけです。残りはその会話には使わず眠ったまま。これが後述するMoEという仕組みで、巨大なのに省エネという設計の秘密です。

このような見た目の数字より本質を見る視点を提供してくれるのが、このギャラリーの最大の価値です。

ギャラリーで最初に注目すべき3つのポイント

ポイント1:デコーダの種類(Dense / Sparse MoE / Hybrid)

各モデルにはデコーダタイプという項目があります。これはAIの脳の構造の大分類です。

Dense(密)タイプは、すべての部品が常に動く昔ながらの設計です。2019年のGPT-2や2024年のLlama 3 8Bがこれにあたります。シンプルでわかりやすい反面、大きくなるほど処理コストも比例して増えます。

Sparse MoE(疎なMixture of Experts)タイプは、多数の専門家を用意しておいて、その質問に合った専門家だけを呼び出す設計です。DeepSeek V3、Kimi K2、Llama 4 Maverickなど最近の大型モデルはほぼこれです。全体は巨大でも、動かす部分は一部だけなので効率的です。

Hybridタイプは、通常の注意機構と線形注意機構を組み合わせた最新の設計です。Qwen3.5 397BやNemotron 3 Nanoなどに採用されています。長い文章を扱う際のコストをさらに削減することを目指しています。

Mixture of Experts(MoE)をわかりやすく言うと:

たとえば病院に内科・外科・皮膚科・眼科の専門医がいるとします。患者が来たとき、全員が出てきて診察するのではなく、症状に合った専門医だけが対応する仕組みです。AIのMoEもこれと同じで、入力した文章の種類に応じて担当の専門家ネットワークだけが動きます。

ポイント2:注意機構の方式(GQA / MLA / SWA)

注意機構とは、AIが文章を読むときにどの単語とどの単語が関係しているかを判断する仕組みです。人間でいえば読解力の核心部分です。

ギャラリーの各モデルには必ず注意機構の種類が記載されています。主な種類を簡単に説明します。

| 名称 | 特徴 | 主な採用モデル |

|---|---|---|

| GQA(Grouped Query Attention) | 標準的な注意機構を効率化したもの。メモリ使用量を抑えられる現在の主流 | Llama 3、Llama 4、Qwen3など多数 |

| MLA(Multi-Head Latent Attention) | 情報を圧縮した形で保持する方式。長い会話でも省メモリで高性能 | DeepSeek V3、Kimi K2、Mistral 3 Largeなど |

| SWA(Sliding Window Attention) | 近くにある単語を優先的に見る方式。長文処理のコストを大幅削減 | Gemma 3、OLMo 3、Arcee TrinityLargeなど |

ギャラリーを時系列で見ると、GQAが土台として普及し、そこにMLAやSWAが加わっていく流れがくっきりと見えます。これは単なる技術の進化ではなく、長い文章を扱う際のコスト問題という共通課題を、各社がそれぞれの方法で解決しようとしている証です。

ポイント3:総パラメータ数よりActive params(実際に動くパラメータ数)

ギャラリーのモデルカードには、パラメータ数が2種類書かれているものがあります。たとえばDeepSeek V3は671B total, 37B activeと書かれています。

この37B activeが本当に重要な数字です。1回の処理で実際に動員されるのは37億パラメータだけ、という意味です。総量671億に比べて、実働は約5.5%に過ぎません。

これはAIの運用コストと直結します。データセンターでAIを動かすとき、実際に電力を消費するのはActiveの部分だけだからです。Kimi K2に至っては総量1兆パラメータに対してActiveは32億という驚きの省エネ設計です。

大きければ偉いという時代は終わりに近づいており、同じ性能をいかに少ないコストで実現するかという設計思想の競争が本番を迎えています。

ギャラリーを通じて見えてくるAIの大きなトレンド

このギャラリーで2019年のGPT-2から2026年最新モデルまでを順番に眺めると、業界全体のトレンドが一本の流れとして見えてきます。

第一段階(〜2023年):GPT-2に代表されるDenseモデルが主流。すべての部品を常に動かすシンプルな設計。性能を上げるにはモデルを大きくするしかなかった。

第二段階(2024年):Llama 3のGQA採用に代表されるように、Denseを維持しながら注意機構を効率化する動きが加速。DeepSeek V3がSparse MoEとMLAを組み合わせた大型モデルで業界に衝撃を与えた。

第三段階(2025〜2026年):Sparse MoEが標準になり、各社が独自の注意機構(SWA、DeltaNet、Lightning Attentionなど)を組み合わせたHybridモデルへと進化。Qwen3.5やLing 2.5、Nemotron 3 Superがこの流れをリードしている。

つまり新しい原理の発見よりも同じ性能をより速く・安く・長く動かす設計の最適化が現在のAI開発競争の本質です。このギャラリーはその競争の全体像を、一つの画面で俯瞰できる貴重な場所になっています。

Hybrid(ハイブリッド)モデルが注目される理由:

通常の注意機構は、文章が長くなるほど計算量が2乗で増えるという弱点があります(例:文章が2倍になると計算量は4倍)。これに対しDeltaNetやLightning Attentionなどの線形注意機構は、文章が長くなっても計算量がほぼ比例して増えるだけです。HybridモデルはこれらをMoEと組み合わせることで、長文処理のボトルネックを根本から解消しようとしています。

専門用語が多くて読めないと感じたら:最初に見るべきモデル5選

ギャラリーには39種類以上のモデルが並んでいるので、初見では圧倒されます。そこで、最初に見るべきモデルを5つ案内します。

1. GPT-2 XL(2019年):これが昔のAIの基本形です。シンプルなDense設計で、他のモデルと比べたときの変化量が実感できます。

2. Llama 3 8B(2024年):Metaが公開したオープンモデルの基準点です。GQAという効率化された注意機構を採用しており、現代のDenseモデルの標準形として位置づけられています。

3. DeepSeek V3(2024年):このモデルが業界を変えました。Sparse MoEとMLAを組み合わせ、671Bという巨大な規模でありながら推論コストを大幅に抑えた設計を実現。多くの後続モデルがこのレシピを参考にしています。

4. Qwen3 235B-A22B(2025年):DeepSeek V3の設計をベースにしつつ、GQA+QK-Normで独自の工夫を加えたモデルです。Alibaba(阿里巴巴)のチームが開発し、性能と効率のバランスに優れています。

5. Qwen3.5 397B(2026年):最新のトレンドであるGated DeltaNetとGated Attentionを3:1で組み合わせたHybrid設計を採用。ここまで見てきた流れの今現在の最前線がこのモデルに凝縮されています。

ポスターにもなる!このギャラリーの意外な使い道

このギャラリーはウェブページとして公開されているだけでなく、物理的なポスターとしても販売されています。RedBubbleやZazzleというプリントグッズサービスで、実際に印刷・購入することができます。

解像度は14570×12490ピクセル(約182メガピクセル)という超高精細仕様。AI研究者の部屋やオフィスの壁に貼って、最新のLLM設計トレンドを日々眺めながら仕事をするという使い方もできます。

またギャラリーの各モデルカードには、元論文へのリンク、HuggingFaceのconfig.jsonへのリンク、コードからの実装例へのリンクまで付いています。この設計を自分のコードで試してみたいという開発者にとっても、出発点として非常に便利な設計になっています。

config.jsonとは何か:

AIモデルの設定ファイルのことです。層の数、各層のサイズ、注意ヘッドの数など、モデルの構造を数値で記述したファイルで、これを見れば設計の詳細がすべてわかります。ギャラリーはこのファイルへの直リンクも各モデルに付けており、研究者や開発者がすぐに深掘りできるようになっています。

このギャラリーをAIニュースを読む眼鏡として使う

LLMアーキテクチャギャラリーは、単なる技術図鑑ではありません。AIの開発競争がどこへ向かっているかを、設計の変化から読み取るための現在地マップです。

このページを見た後、AIに関するニュースを読むと見え方が変わります。新しいAIが出たという話を聞いたとき、どんな設計タイプかActiveパラメータはどれくらいかどんな注意機構を使っているかという視点で読めるようになります。

専門用語が多くて最初は戸惑うかもしれませんが、Dense → Sparse MoE → Hybridという大きな流れと、GQA → MLA / SWA / DeltaNetという注意機構の進化という2本の軸を覚えておけば、このギャラリーは格段に面白く読めるようになります。

AIの世界は日々進化しています。このギャラリー自体も定期的に更新されており、新しいモデルが登場するたびに追加されていきます。AIのトレンドを追いかける習慣をつけたい方の、最初の一歩としてぜひ訪れてみてください。

コメント